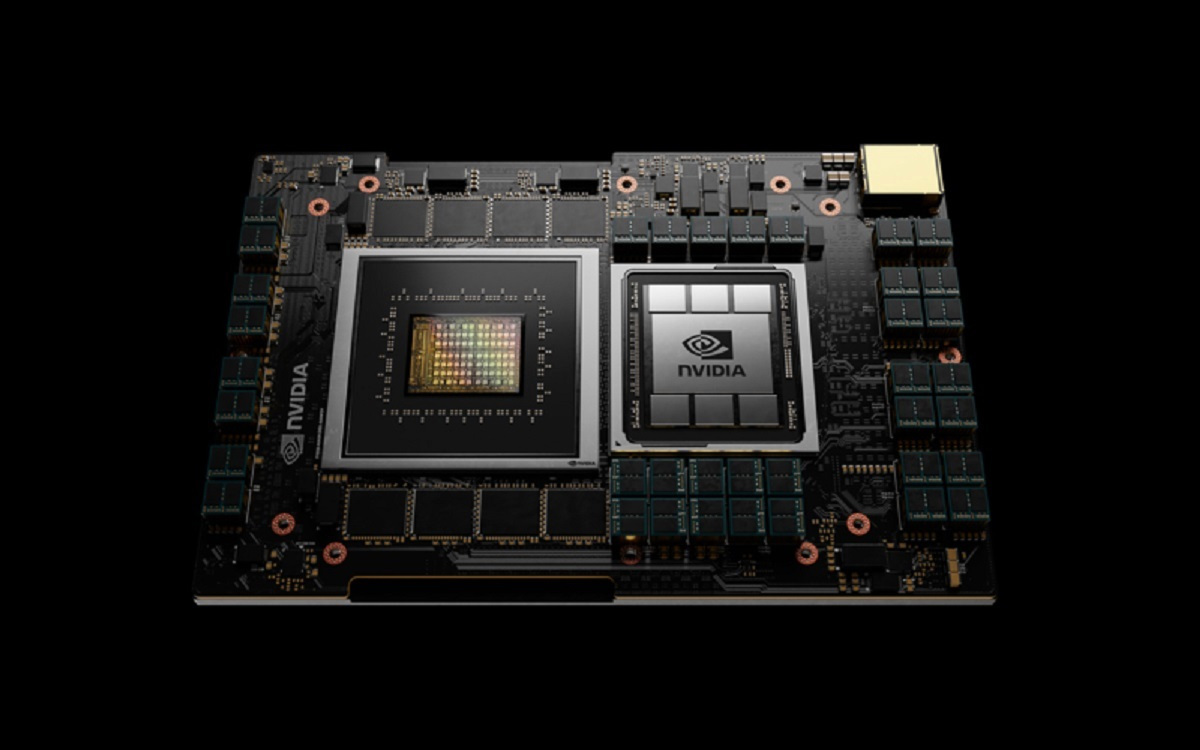

Nvidia presentó su procesador Grace. Es una unidad de procesamiento central (CPU) basada en ARM para aplicaciones informáticas de alto rendimiento e inteligencia artificial a gran escala.

(VB)-Es la primera CPU de centro de datos de Nvidia, diseñada específicamente para aplicaciones que operan a una escala gigante, dijo el CEO de Nvidia, Jensen Huang, en un discurso de apertura en el evento GTC 2021 de Nvidia.

Grace ofrece un salto de rendimiento 10 veces superior para sistemas que entrenan modelos gigantes de IA, utilizando núcleos ARM energéticamente eficientes. Y Nvidia dijo que el Swiss Supercomputing Center y el Laboratorio Nacional de Los Alamos del Departamento de Energía de EE. UU. Serán los primeros en usar Grace, que lleva el nombre de Grace Hopper , quien fue pionera en la programación de computadoras en la década de 1950. Se espera que la CPU esté disponible a principios de 2023.

“Grace es una CPU revolucionaria. Está diseñado específicamente para aplicaciones informáticas aceleradas de escala gigante para IA y HPC ”, dijo Paresh Kharya, director senior de gestión de productos y marketing de Nvidia, en una rueda de prensa.

Huang dijo: «Es la primera CPU del mundo diseñada para computación a escala de terabytes».

La CPU es el resultado de más de 10.000 años de trabajo de ingeniería. Nvidia dijo que el chip abordará los requisitos informáticos para las aplicaciones más avanzadas del mundo, incluido el procesamiento del lenguaje natural, los sistemas de recomendación y la supercomputación de IA, que analizan

enormes conjuntos de datos que requieren un rendimiento informático ultrarrápido y una memoria masiva.

Grace combina núcleos de CPU ARM de bajo consumo energético con un innovador subsistema de memoria de bajo consumo para ofrecer un alto rendimiento con gran eficiencia. El chip utilizará un núcleo ARM futuro denominado Neoverse.

“La inteligencia artificial de vanguardia y la ciencia de datos están empujando la arquitectura informática actual más allá de sus límites, procesando cantidades impensables de datos”, dijo Huang en su discurso. “Usando ARM IP con licencia, Nvidia ha diseñado Grace como una CPU específicamente para AI y HPC a gran escala. Junto con la GPU y la DPU, Grace nos brinda la tercera tecnología fundamental para la computación y la capacidad de rediseñar el centro de datos para avanzar en la inteligencia artificial. Nvidia es ahora una empresa de tres chips «.

Grace es un procesador altamente especializado que apunta a cargas de trabajo, como el entrenamiento de modelos de PNL de próxima generación que tienen más de 1 billón de parámetros. Cuando se combina estrechamente con las GPU de Nvidia, un sistema basado en Grace ofrecerá un rendimiento 10 veces más rápido que los sistemas actuales basados en Nvidia DGX, que se ejecutan en CPU x86. En una rueda de prensa, alguien preguntó si Nvidia competirá con los chips x86 de Intel y AMD.

Kharya dijo: «No competimos con x86 … seguimos funcionando muy bien con CPU x86».

Grace está diseñado para aplicaciones de IA y HPC, pero Nvidia no revela información adicional sobre dónde se utilizará Grace hoy. Nvidia también se negó a revelar la cantidad de transistores en el chip Grace.

Nvidia presenta Grace a medida que el volumen de datos y el tamaño de los modelos de IA crecen exponencialmente. Los modelos de IA más grandes de la actualidad incluyen miles de millones de parámetros y se duplican cada dos meses y medio. Entrenarlos requiere una nueva CPU que se pueda acoplar estrechamente a una GPU para eliminar los cuellos de botella del sistema.

«El mayor anuncio de GTC 21 fue Grace, una CPU estrechamente integrada para más de un billón de modelos de parámetros de inteligencia artificial», dijo Patrick Moorhead, analista de Moor Insights & Strategies. “Es difícil abordar aquellos con CPU y GPU x86 clásicas conectadas a través de PCIe. Grace se centra en la E / S y el ancho de banda de la memoria, comparte la memoria principal con la GPU y no debe confundirse con las CPU de centro de datos de propósito general de AMD o Intel «.

El rendimiento subyacente de Grace es la tecnología de interconexión Nvidia NVLink de cuarta generación, que proporciona conexiones de 900 gigabytes por segundo entre las unidades de procesamiento de gráficos (GPU) Grace y Nvidia para permitir un ancho de banda agregado 30 veces mayor en comparación con los servidores líderes de la actualidad.

Grace también utilizará un innovador subsistema de memoria LPDDR5x que ofrecerá el doble de ancho de banda y una eficiencia energética 10 veces superior en comparación con la memoria DDR4. Además, la nueva arquitectura proporciona coherencia de caché unificada con un único espacio de direcciones de memoria, combinando el sistema y la memoria de la GPU HBM para simplificar la programabilidad.

“La plataforma Grace y su CPU Arm son un gran paso nuevo para Nvidia”, dijo Kevin Krewell, analista de Tirias Research, en un correo electrónico. “El nuevo diseño de una CPU personalizada conectada a la GPU con NVlinks coherentes es el nuevo diseño de Nvidia para escalar a modelos de IA ultra grandes que ahora tardan días en ejecutarse. La clave de Grace es que al usar la CPU Arm personalizada, será posible escalar a arreglos DRAM LPDDR5 más grandes de lo que es posible con memoria de gran ancho de banda directamente conectada a las GPU”.

Grace impulsará la supercomputadora más rápida del mundo para la organización suiza. Apodada Alpes, la máquina contará con 20 exaflops de procesamiento de IA. (Esto se refiere a la cantidad de computación disponible para aplicaciones de IA). Eso es aproximadamente 7 veces más computación que la disponible con la supercomputadora Nvidia Seline de 2.8 exaflop, la supercomputadora de IA líder en la actualidad. HP Enterprise construirá el sistema Alps.

Alps trabajará en problemas en áreas que van desde el clima y el tiempo hasta las ciencias de los materiales, la astrofísica, la dinámica de fluidos computacional, las ciencias de la vida, la dinámica molecular, la química cuántica y la física de partículas, así como en dominios como la economía y las ciencias sociales, y estará en línea en 2023. Alps hará cálculos de física y química cuántica para el colisionador Hadron, así como modelos meteorológicos.

«Esta es una arquitectura muy equilibrada con Grace y una futura GPU Nvidia, que aún no hemos anunciado, para permitir una investigación de vanguardia en una amplia gama de campos», dijo Kharya.

Mientras tanto, Nvidia también dijo que pondría a disposición sus chips gráficos con la CPU basada en ARM Graviton2 de Amazon Web Services para centros de datos para computación en la nube.

Con Grace, Nvidia se embarcará en un patrón de varios años de creación de unidades de procesamiento de gráficos, CPU y unidades de procesamiento de datos (CPU), y alternará entre diseños de arquitectura Arm y x86, dijo Huang.